Nonostante Gpt-4o abbia dimostrato di essere in grado di sostenere una conversazione anche in italiano, i più noti chatbot in circolazione sono addestrati in inglese, ragionano in inglese e poi traducono. Ma LLaMAntino, il modello linguistico di grandi dimensioni (LLM) made in Italy, è stato invece nutrito dal dipartimento di Informatica dell’Università degli Studi di Bari con dati in italiano. E nella classifica degli LLM di Hugging Face è al sesto posto dietro ai prodotti di Meta e Mistral.

Altri progetti su LLM italiani sono stati avviati da gruppi di ricerca dell’Università La Sapienza di Roma e dell’Università di Pisa, oltre a quello a cui sta lavorando Fastweb.

COS’È UN LLM E A COSA SERVE NELL’IA

Se Gpt-4o sa capire quello che gli diciamo, scriviamo o mostriamo – emozioni comprese – è grazie a un modello linguistico di grandi dimensioni (Large Language Model, LLM), che viene addestrato con una grande quantità di testi provenienti da diverse fonti.

Gli LLM, infatti, spiega Punto Informatico, sono “un tipo di modello di intelligenza artificiale che usa reti neurali profonde per apprendere da enormi quantità di dati testuali, come testi scritti o parlati”. Nel processo di addestramento il modello impara la grammatica, la sintassi e altri elementi utili, e viene poi valutato sulla sua capacità di generare testi coerenti e sensati a partire dall’input fornito.

PERCHÉ (QUASI) TUTTI GLI LLM “PENSANO” IN INGLESE

Sebbene i più noti chatbot – ChatGpt di OpenAI, Llama di Meta, Gemini di Google, Copilot di Microsoft, Claude di Anthropic – abbiano tutti alle spalle grandi aziende statunitensi (o grandi finanziamenti come nel caso della francese Mistral AI), il motivo per cui “pensano” e funzionano meglio in inglese – nonostante possano poi tradurre anche in altre lingue – non è questo.

Le ragioni, come ha osservato Dietrich Klakow, professore che svolge attività di ricerca presso il Saarland Informatics Campus, sono due. La prima è che la maggior parte delle applicazioni di elaborazione linguistica si basa sull’apprendimento automatico (machine learning), un sottocampo dell’intelligenza artificiale (IA).

“Nell’apprendimento automatico, il programmatore non dice all’algoritmo esattamente cosa fare, ma lo addestra con grandi quantità di dati dai quali l’algoritmo può imparare da solo”, ha detto Klakow. E l’inglese è la lingua più parlata al mondo, quindi la maggior parte dei dati di addestramento disponibili sono in inglese. “Inoltre, l’inglese è relativamente semplice in termini di grammatica ed è per questo che i computer se la cavano bene”.

La seconda ragione, per il professore, sono i ricercatori stessi: “La scienza è un campo di lavoro internazionale, quindi la lingua di lavoro è solitamente l’inglese, anche nell’informatica”. Questo, a sua volta, fa sì che molte applicazioni vengano sviluppate prima nella lingua di Shakespeare. “La maggior parte delle applicazioni ha un vantaggio pluriennale in inglese – ha aggiunto Klakow -. E le principali lingue europee sono di solito le prime a seguire l’esempio”.

LLAMANTINO, L’IA CHE “PENSA” IN ITALIANO

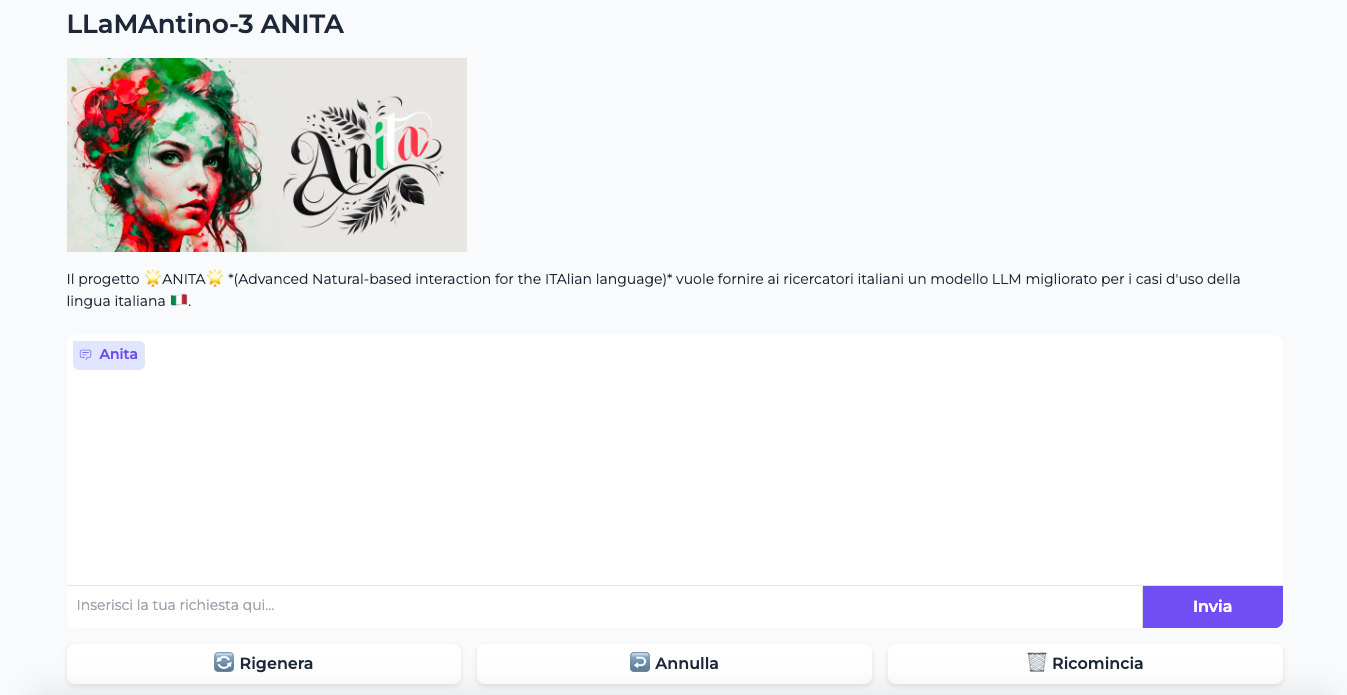

L’Italia, però, sta lavorando a una sua versione. È il caso di LLaMAntino, un modello basato su Llama 3 e sviluppato da un gruppo di ricerca del dipartimento di Informatica dell’Università degli Studi di Bari, che l’ha addestrato con testi italiani grazie al supercomputer Leonardo, custodito da Cineca, il consorzio interuniversitario di Bologna.

Oggi, secondo la classifica degli LLM che parlano italiano, stilata da Hugging Face, LLaMAntino occupa il sesto posto dopo due prodotti di Meta, due di Mistral AI e uno di Cohere.

Hugging Face è una società franco-americana con sede a New York che sviluppa strumenti di calcolo per la creazione di applicazioni utilizzando l’apprendimento automatico. È considerato il verificatore indipendente di modelli di IA migliore al mondo ed è stato valutato 2 miliardi di dollari, motivo per cui anche Microsoft ci sta collaborando.

PERCHÉ UNA IA MADE IN ITALY

Per Giovanni Germani, data scientist di Fastweb, che sta sviluppando una IA in Italiano, ci sono almeno un paio di motivi per preferire un chatbot italiano: “Uno è il controllo e la sovranità dei dati, fondamentale per le aziende. L’altro è la perfomance sulla lingua”.

“Addestrare da zero in italiano un’Ai generativa è l’unico modo per evitare che pensi in inglese. E pensare in italiano – ha aggiunto – è importante per un’azienda che vuole magari un chatbot in grado di rispondere ai clienti italiani comprendendo esattamente quello che vogliono dire, rispondendo con testi corretti e precisi”.

GLI ALTRI MODELLI ADDESTRATI IN ITALIANO

A livello universitario LLaMAntino non è l’unico progetto italiano. Ci sono anche Cerbero all’ateneo di Pisa e Fauno, Camoscio e Dante a La Sapienza di Roma.

Per i ricercatori toscani, “se tutto va bene [il loro LLM] sarà buono come Mistral, ma con una licenza del tutto open”. Inoltre, “la scelta dei testi in italiano su cui è stato addestrato doveva rispettare parametri molto alti dal punto di vista linguistico”.

Anche PagoPa sta lavorando al suo LLM con Zefiro, un modello nostrano “per non affidarci a big player stranieri”, ha detto lo sviluppatore Alessandro Ercolani, il quale ha sottolineato l’importanza di adottare un approccio open source affinché lo sviluppo di queste tecnologie sia aperto e condiviso con tutti.

In ambito privato, invece, oltre a Fastweb, che inaugurerà a breve un data center in Lombardia, dove un supercomputer addestrerà da zero con testi in italiano il loro modello, c’è anche iGenius di Uljan Sharka, il cui LLM è realizzato insieme a Cineca.