Da tempo l’Unione Europea—risolti gli altri problemi del momento—è alle prese con l’interessante questione di come dare lo status di “persona legale” alle mentalità artificiali, cioè alle menti robotiche autonome capaci di auto-apprendimento, con o senza un corpo umanoide. Una relazione del Parlamento Europeo alla Commissione suggerisce infatti che si debba procedere ora al riconoscimento della “personhood” dei robot. Lo scopo neanche troppo velato è quello di trovare modo di tassare i redditi che queste “creature” potrebbero generare, insieme forse con il dubbio che i costrutti intelligenti e autonomi potrebbero non essere governabili con le tecniche del tradizionale “monopolio di violenza” esercitato dagli Stati. Se un robot completamente autonomo non vuole pagare le tasse o insiste per esprimere opinioni eversive, servirebbe a qualcosa arrestarlo, sequestrare la sua auto, farlo cacciare dal posto di lavoro? Soffre se lo si spegne? Poi come paga? Nascono importanti questioni morali e di responsabilità legale, come nel caso del comportamento “etico” delle automobili senza conducente. Per dare ai veicoli regole accettabili per la popolazione umana, dobbiamo prima chiarirci noi su cosa crediamo veramente, un processo difficile e forse neanche possibile.

Per esempio, un’importante ricerca sul tema rivela che—secondo la netta maggioranza dei rispondenti—il veicolo robotico, messo in condizioni di dovere forzosamente decidere chi tra due pedoni investire, dovrebbe ammazzare l’anziano per salvare il bambino. Ciò corrisponderà al sentimento comune, ma i vecchi cosa ne pensano? Sarebbe più equo se l’auto procedesse semplicemente a casaccio, alla maniera autenticamente umana? C’è anche la questione del crimine robotico quando le mentalità artificiali si programmano da sole per ottimizzare dei risultati prefissi. È già successo a Wall Street che dei computer finanziari, predisposti per ottimizzare i ritorni sugli scambi—e interagendo per le operazioni con altri computer loro consimili— hanno insieme riconosciuto nei flussi dei dati delle caratteristiche che gli hanno permesso di collaborare per aumentare i guadagni in una maniera che sarebbe illegale tra operatori umani.

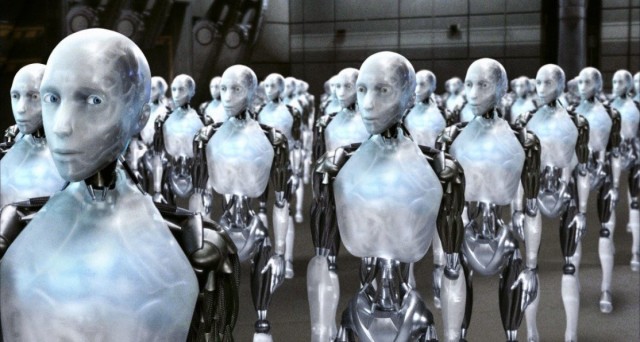

Tenendo presente che in legge la commissione di un crimine presuppone anche “l’intento” criminale, allora chi ha rubato? L’operatore umano, che non poteva prevedere il comportamento? Il computer? Dov’è l’intento? Il vero problema con il nostro futuro cibernetico non è l’emergere di un’intelligenza artificiale tiranna alla guida di un esercito di killer robot. Piuttosto, avendo gli esseri umani creato nei millenni una sorta di modello mentale che offre una tollerabile spiegazione del creato e che, pur zoppicando, ci permette di trovare adeguati compromessi comportamentali, come ci orienteremo nel nuovo mondo che arriva? Davanti a questi scenari, appena comprensibili, la tentazione di almeno rendere le mentalità autonome personalmente responsabili delle proprie azioni è forte e comprensibile. Potrà anche essere fonte di sviluppi oggi inimmaginabili. Quando, nel Tredicesimo, Papa Innocenzo IV stabilì la personalità giuridica dei monasteri, pose—sicuramente senza volerlo—la base dell’organizzazione economica in aziende e società per azioni che caratterizza il mondo di oggi. Piantò il seme che generò il capitalismo.