L’Unione europea fa le regole sull’intelligenza artificiale ma non l’intelligenza artificiale. Questo refrain sottolinea, da un lato, l’approccio normativo europeo, dall’altro l’assenza di un sistema domestico di intelligenza artificiale.

Risolvere l’enorme tema della trattazione europea dell’intelligenza artificiale con una battuta significa non tenere conto della stratificazione culturale e di un approccio europeo all’innovazione.

Un approccio che fa della tutela dei diritti attore centrale della partita dell’AI.

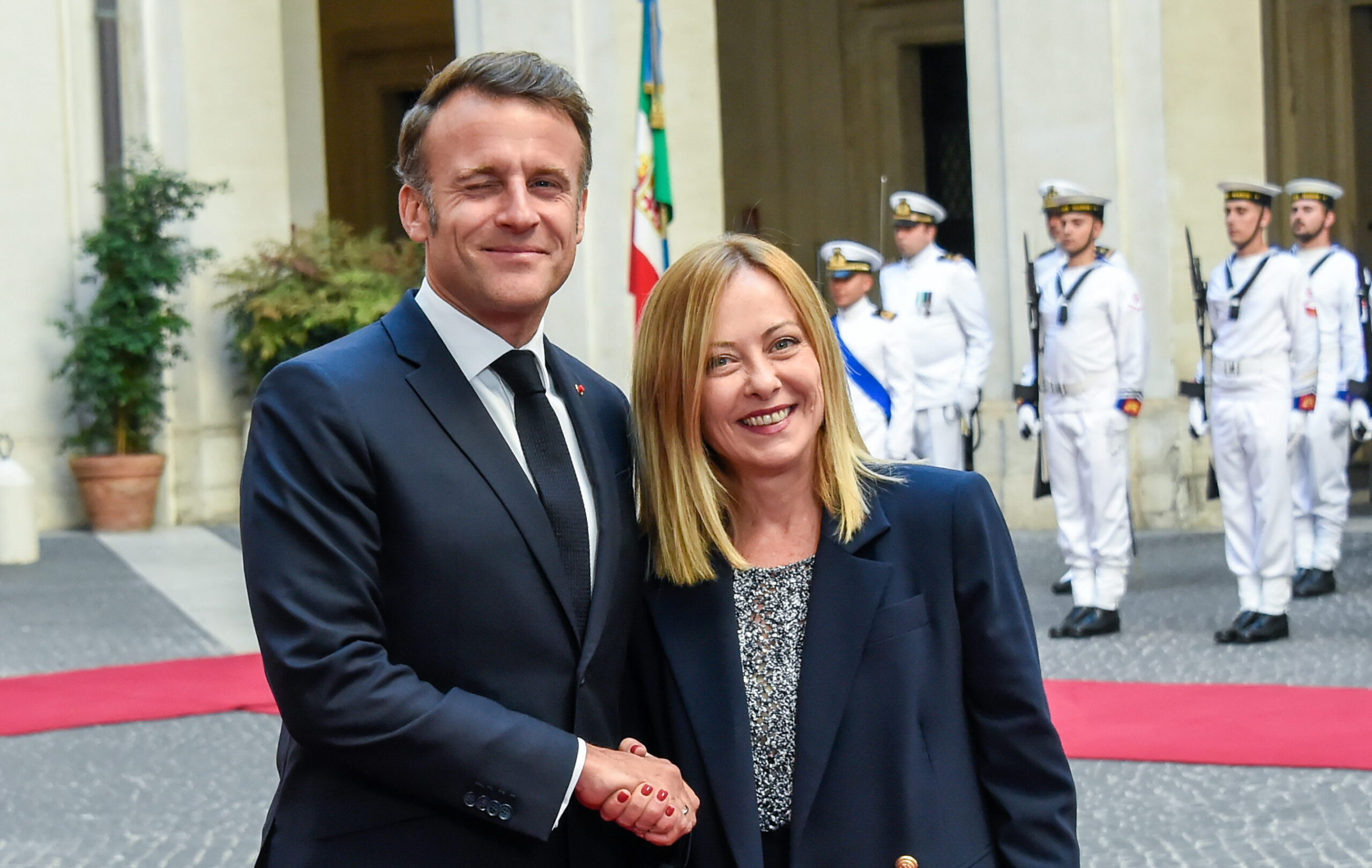

Ne abbiamo parlato con il prof. Antonino Rotolo, professore di informatica giuridica presso l’Università di Bologna e responsabile di EUSAiR, incontrato a margine del convegno “La legge dell’AI” nell’ambito del Meeting di Rimini.

Perché l’intelligenza artificiale va normata?

Perché l’intelligenza artificiale può generare un impatto davvero importante sulla società e sulla vita delle persone. È una tecnologia disruptive che può, soprattutto grazie alle accelerazioni degli ultimi anni, avere un impatto enorme nel settore del lavoro, nella vita privata, nei processi di apprendimento, nell’industria e nella manifattura.

La regolazione giuridica dell’intelligenza artificiale è una prerogativa europea?

Questa è la narrazione che arriva soprattutto da un certo mondo americano ma non è così. Vero è che noi europei abbiamo una grande attenzione al tema della tutela dei diritti delle persone ma non solamente sul tema dell’intelligenza artificiale in generale. Abbiamo una tradizione che ci porta a volere tecnologie sicure per le persone.

In questa tradizione si inserisce l’AI Act, il regolamento europeo sull’intelligenza artificiale che costituisce uno dei primi tentativi sistematici di disciplinare il ricorso all’IA.

Un lungo parto, sono serviti molti anni per arrivarci e ora genera tutta una serie di sviluppi. Io tema da discutere é quello della sua applicazione, perché non si applica da solo ha bisogno di una serie di misure tecniche.

Quali sono i soggetti che hanno bisogno della regolazione giuridica dell’AI?

Tutti i soggetti che con l’AI ci lavorano. Il mondo industriale, coloro che utilizzano l’AI per attività produttive o che sviluppano l’intelligenza artificiale. Ci sono settori produttivi in cui le regole sono parte del gioco, come, per esempio, l’AI applicata al settore bancario o alla salute, lì è impensabile immaginare che l’intelligenza artificiale non sia sicura. Quindi il diritto non è solamente un elemento che ostacola o che rallenta l’innovazione ma è parte del gioco competitivo.

L’approccio regolatorio europeo può essere un freno oppure un elemento propulsore nella sfida dell’AI?

Regolare non significa ostacolare il processo di innovazione. L’Europa non è in ritardo rispetto agli Stati Uniti e la Cina per via della regolazione. Perché anche la Cina regola, anzi regola in una maniera rigorosissima, per ragioni diverse, evidentemente, perché per loro la regolazione è una forma di controllo della tecnologia. Però la Cina, in questo momento, compete con gli Stati Uniti. Il tema è un altro.

Quale?

Il tema è che se la regolamentazione è fatta male allora può essere un ostacolo. Una regolamentazione frammentata, non coerente, realizzata in maniera spot è un freno all’innovazione. Ecco questa è una delle malattie della regolamentazione in Italia ma in parte anche in Europa.

Ci fa un esempio?

Se facciamo un sistema di intelligenza artificiale nell’ambito dei dispositivi medici non dobbiamo applicare solamente l’AI Act europeo ma anche altri regolamenti europei, altre regolazioni di settore europee e nazionali. Questo il grande tema: la stratificazione legislativa e la stratificazione delle autorità.

Qual è il contributo delle autorità italiane e degli enti italiani all’applicazione dell’AI Act europeo?

Il problema non è l’incapacità delle autorità. L’intelligenza artificiale è una tecnologia orizzontale e pervasiva, ogni settore ha sue certificazioni di sicurezza. Il tema è che questa frammentazione della regolamentazione e questa molteplicità di autorità su una tecnologia che è così pervasiva a livello orizzontale, non sempre riesce ad essere efficiente e necessita di un grande sforzo di coordinamento. Questo è uno dei grandi temi: come coordinare i regolatori.

A che punto siamo con le applicazioni di intelligenza artificiale al complesso del mondo della giustizia?

Nell’ambito della giustizia vanno distinti due grandi mondi. Da un lato la giurisdizione, quindi magistratura, giudici, ministero della giustizia, e poi, dall’altro, le professioni legali.

In quest’ultimo settore il legal tech è un mercato molto fiorente, soprattutto per ciò che riguarda strumenti capaci di fare analisi di dati, analisi di sentenze e di materiale legislativo.

Invece la giurisdizione e i magistrati come si relazionano all’intelligenza artificiale?

Ecco l’intelligenza artificiale in quell’ambito viene erroneamente accompagnata dal concetto di giustizia predittiva, cioè “il giudice robot”. Ecco, nessuno che si occupi di questo tema a livello professionale e serio propone un approdo del genere. Piuttosto, ci sono strumenti di intelligenza artificiale che possono, per esempio, “pesare” il fascicolo, cioè valutare i rischi di prescrizione. Una valutazione di rischio ex ante, poi il giudice decide autonomamente. Questo è un uso assolutamente pacifico e molti magistrati cominciano a rendersene conto. Infine, c’è il mondo della legislazione: l’Ai è utilizzata anche a supporto delle attività legislative e parlamentari.

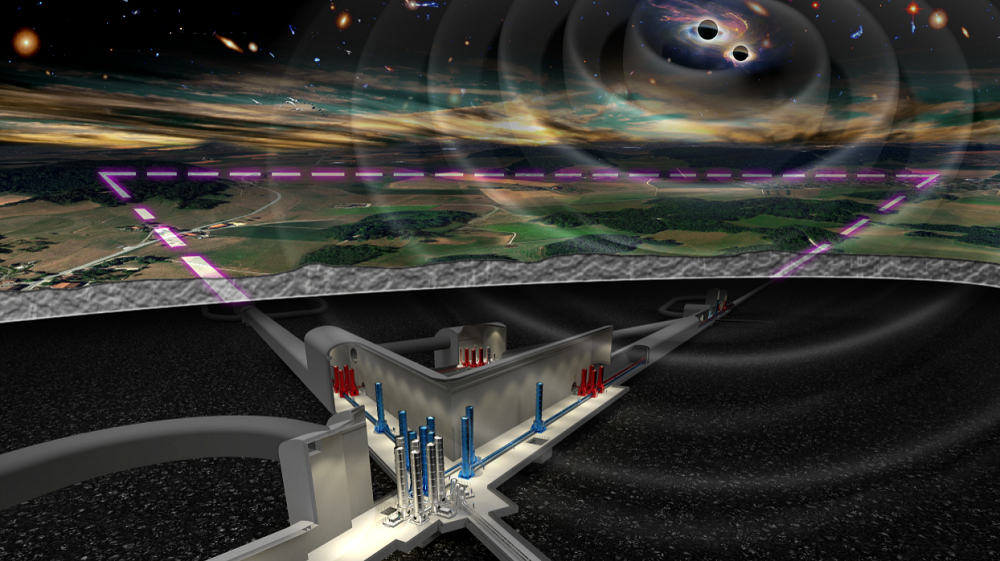

È possibile immaginare lo sviluppo è di un’intelligenza artificiale europea?

Sì, è auspicabile. Un’AI che abbia standard europei e rispetti i principi dell’interoperabilità. L’Unione Europea già ha preso posizione nei confronti di alcune aziende americane, le quali lamentano la regolamentazione europea ma perché essa sta ponendo delle questioni serie. Quindi tornando alla sua domanda di partenza: l’UE fa la regolamentazione e non l’AI? Io le dico che se non se non facciamo l’AI europea non la stiamo regolando davvero, stiamo solo mettendo delle regole a un sistema che arriva da fuori. E senza regolamentazione siamo fritti.

Perché l’Europa non ha ancora sviluppato la sua intelligenza artificiale?

E questo è un tema che parla di modelli di innovazione, modelli di investimento, capacità di fare massa critica negli investimenti, capacità di investire in tecnologie disruptive. L’Europa è avversa al rischio e adotta una logica incrementale nell’innovazione, cioè finanzia ciò che esiste già. Gli Stati Uniti hanno bruciato le tappe perché hanno avuto la capacità di prendersi dei rischi enormi dal punto di vista delle tecnologie. L’Europa probabilmente recupererà un po’ di gap in alcuni settori, non in tutti ma sicuramente in alcuni settori, quelli che sono maggiormente legati al concetto di sicurezza e di tutela dei diritti delle persone.