Caro direttore,

stamani sfogliavo pigramente LinkedIn quando sono incappato nell’intervento tra il preoccupato e lo sconcertato di un amico che condivideva questa pubblicità che allego alla mia letterina.

Ha subito attirato la mia attenzione perché mentre si fa un gran parlare dei danni che può causare a scuola ChatGpt se è quel pugno di algoritmi a fare tesine, ricerche e compiti in classe, nessuno mi pare finora abbia messo in discussione se vogliamo vivere in un mondo in cui anche i professionisti (avvocati, ingegneri, architetti) si affidino all’intelligenza artificiale per le loro prestazioni professionali.

In verità parte della nuova normativa italiana sull’AI sfiora questi ambiti, in particolar modo mi pare si concentri sull’uso dell’Ai nella giustizia, ma non mi sembra dia le risposte di cui presto potremmo aver bisogno in tema sanità, ovvero: che fare quando sono i medici ad affidarsi a ChatGpt?

Il ddl italiano stabilisce che in caso di utilizzo dell’intelligenza artificiale in ambito sanitario sarà obbligatorio informare i cittadini. Tutto qui? Tutto qui. Non ho letto molto altro sui pochi giornali che si sono interessati della cosa.

Leggo invece simili reclame e mi si riempie la testa di dubbi.

Sia chiaro, nonostante l’età non sono uno di quelli che sostiene che i commercialisti dovrebbero usare l’abaco anziché la calcolatrice. Voglio però che il mio commercialista ricontrolli tutti i conti due volte.

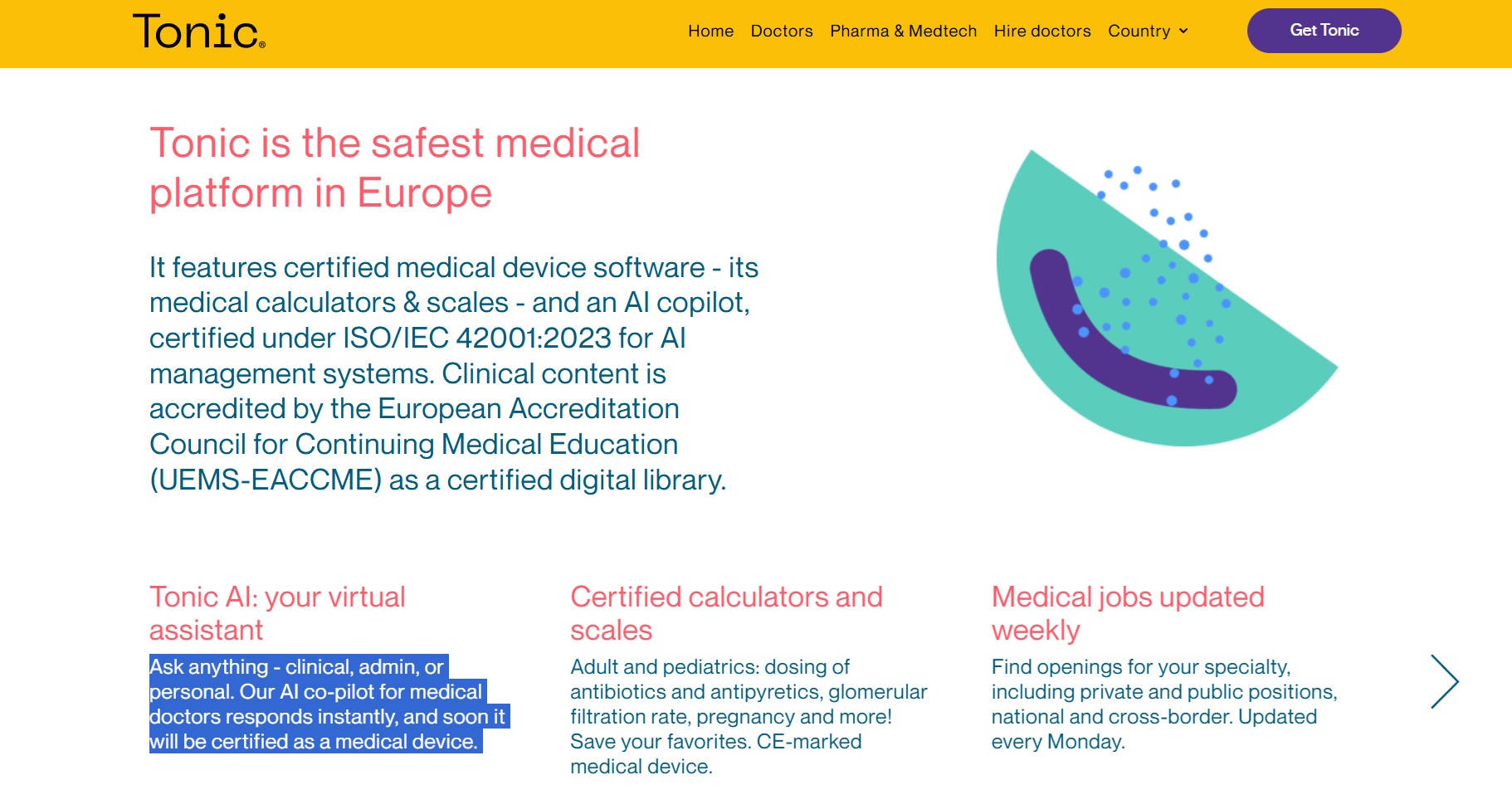

Leggo sul sito dell’azienda Tonic Easy Medical: “Chiedi qualsiasi cosa: clinica, amministrativa o personale. Il nostro copilota AI per medici risponde all’istante e presto sarà certificato come dispositivo medico”. Mi pare un modo di fare molto americano: prima si dà in pasto al mercato un prodotto, poi lo si certifica? E, nel mentre cosa sarebbe?

Da cittadino vorrei tanto avere risposta perché vado da un medico della mutua che ha meno della metà dei miei anni e vorrei sapere se le sue diagnosi siano frutto dei suoi studi o dell’elaborazione di un algoritmo simile a ChatGpt. Vorrei saperlo soprattutto perché quando io stesso ho giochicchiato con l’originale (quello di Sam Altman insomma) o mi ha risposto corbellerie oppure con parole da conversazione. Non ci ho visto grandi barlumi di intelligenza. Perciò passino le questioni amministrative e la gestione dei database, ma davvero vogliamo demandargli pure quelle cliniche?

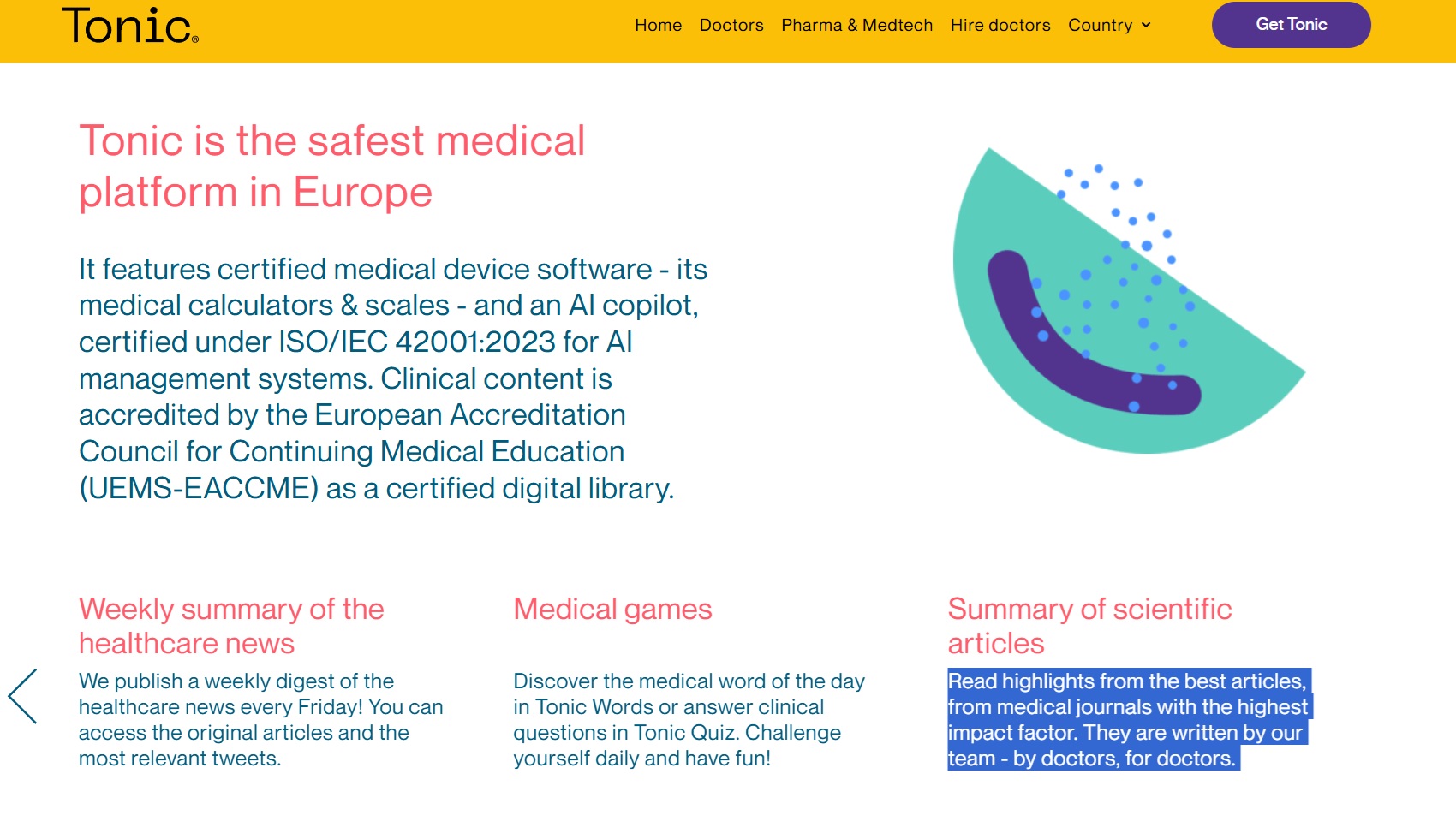

L’impresa in questione, portoghese, sarà sicuramente serissima. Anzi, tu che sei molto più sul pezzo di me magari mi dirai che è la nuova Microsoft o che ce ne sono già altre diecimila che fanno le stesse cose. Può essere, ma intanto ho voluto capire qualcosa in più su questa che si reclamizza online. Leggo per esempio su di un sito che immagino raccolga comunicati stampa che “L’azienda sta inoltre seguendo il processo di valutazione di conformità MDR per i suoi sistemi di intelligenza artificiale ad alto rischio, ai sensi del Regolamento europeo sui dispositivi medici (Regolamento (UE) 2017/745) e per la conformità ai requisiti ad alto rischio dell’Atto UE sull’intelligenza artificiale, tra cui la gestione del rischio, la governance dei dati, la trasparenza e i controlli di supervisione umana. Il suo sistema di gestione della qualità è già certificato ISO 13485:2016 (certificato MD 800345), coprendo ogni fase del ciclo di vita del dispositivo medico, dalla progettazione e sviluppo alla convalida, alla sorveglianza post-commercializzazione e al miglioramento continuo”.

Insomma, questa azienda co-fondata nel 2016 da Daniela Seixas, Ceo, e da Andrew Barnes, Christophe de Kalbermatten e David Borsos sembra voler avere tutti i crismi e intenzionata a seguire alla lettera ogni normativa. Benissimo. Ha già una quarantina di dipendenti e, leggo sempre sul sito che raccoglie comunicati stampa, “è utilizzata da oltre 200.000 medici per rendere più efficiente la pratica clinica quotidiana, centralizzando risorse essenziali come strumenti di intelligenza artificiale, calcolatori medici, contenuti accreditati ECM, alberi decisionali, database dei farmaci, offerte di lavoro, notizie mediche e altro ancora”.

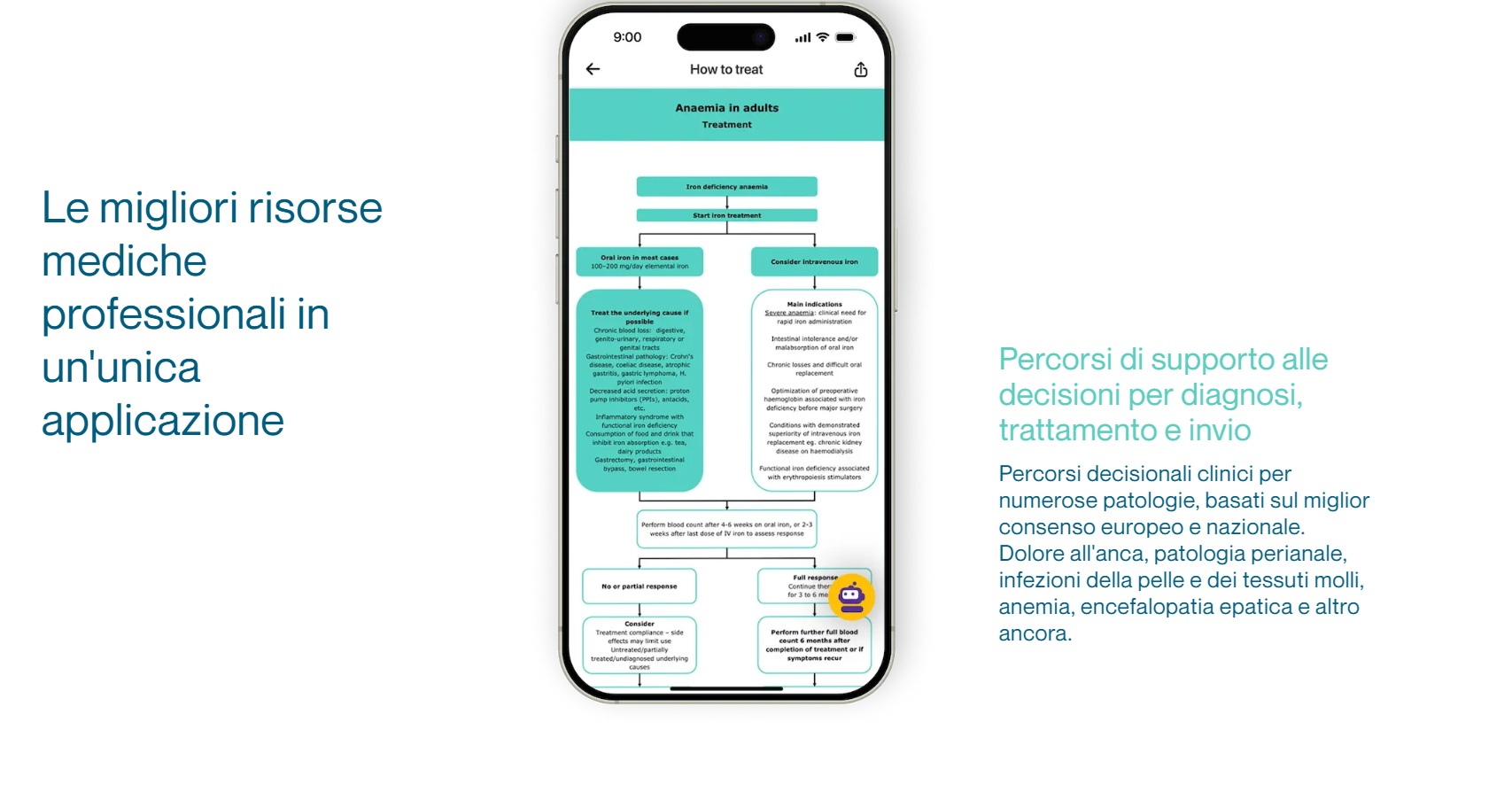

Però appunto loro saranno serissimi, ma quanto possono essere seri i medici che, anziché sfogliare riviste scientifiche e testi universitari, si affidano a ChatGpt? E questi 200mila medici diranno ai loro pazienti che si avvalgono di simili aiuti che, secondo quanto leggo sul sito ufficiale, includono pure “percorsi di supporto alle decisioni per diagnosi”?

C’è’ poi un altro aspetto che mi ha lasciato inquieto: l’app contiene pure riassunti di articoli medici.

In questo caso l’azienda portoghese sottolinea che sono scritti dal team e non elaborati da ChatGpt (evidenziando dunque che l’Ai è fallibile), però mi chiedo: perché i dottori hanno bisogno di lavorare sulla base di riassunti scritti da altri?

Io ho sempre lavorato sulla base delle informazioni scritte da me e immagino che tu, direttore, quando scrivi un pezzo raccogli da te il materiale necessario, non chiedi a qualche collega (magari a uno stagista) di sminuzzarti informazioni reperite online delle quali poi dovrai fidarti ciecamente.

Se fino a ieri i medici si sono aggiornati leggendo articoli scientifici interi, perché ora dovrebbero passare ai riassunti? Tu andresti da un dottore che si è laureato usando bigini? E che si aggiorna coi bignami?

Io no, ma probabilmente sono di tutt’altra scuola, quella nella quale si andava avanti contando esclusivamente sulle proprie forze e non si aveva bisogno di essere continuamente assistiti dall’intelligenza artificiale.

All’inizio della letterina ricordavo il dibattito sull’intelligenza artificiale che scrive compiti e fa tesine: ecco, se ora indosserà il camice, forse fanno bene i nostri ragazzi a fare scena muta alla maturità: che senso ha, infatti, studiare, se le risposte ci vengono inculcate non dalla conoscenza ma dall’algoritmo?

Un preoccupato e dubbioso

Francis Walsingham