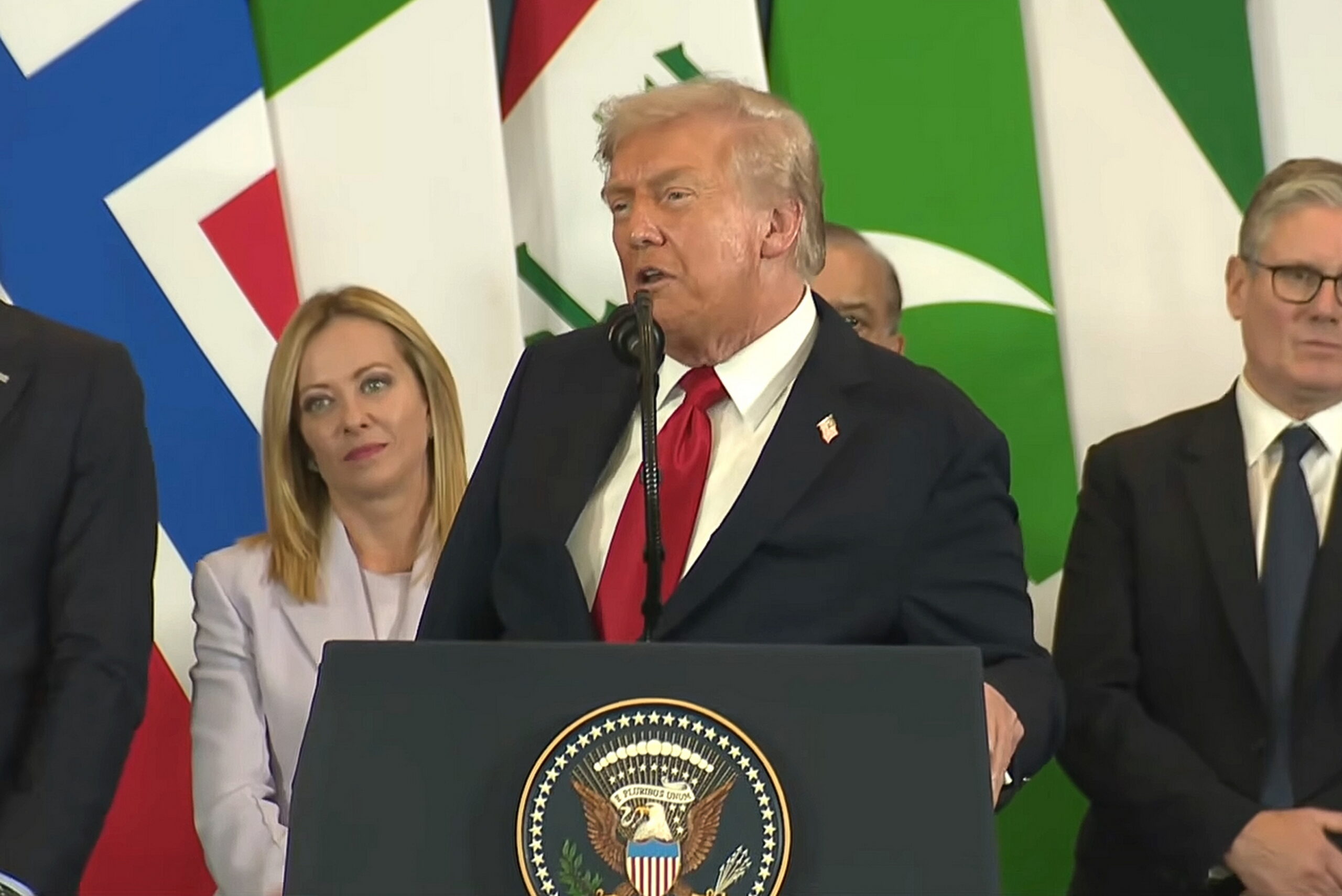

Era già molto vicino ai cento anni quando Henry Kissinger, appena scomparso, con Eric Schmidt e Daniel Huttenlocher pubblicava l’ultimo libro della sua vita: “L’era dell’intelligenza artificiale”. Fa indubbiamente pensare che il Talleyrand della politica americana si sia interessato ad un argomento così di avanguardia lavorando a sei mani con un imprenditore e filantropo e con il decano dell’informatica del Massachusetts Institute of Technology. Ma evidentemente il tema non è poi così innovativo se ormai è diventato argomento di salotto e proposte – non sappiamo fino a che punto consapevoli – di capi di stato in giro per il mondo.

E in effetti se pensiamo – è storia documentata – che un algoritmo ha collezionato una serie di vittorie a scacchi nel 2017 contro un team di esperti, trovando soluzioni empie di cinismo a cui la mente umana non sarebbe stata in grado di ricorrere, possiamo ben considerare che ormai l’intelligenza artificiale sta già dominando molti scenari, non ultimo quello delle applicazioni militari, delle scienze sociali e della biologia, con una velocità che sta superando quella della stessa storia che la circonda. Quali sono i rischi di questa innovazione? Molti, ne siamo persuasi, perché fondamentalmente non crediamo nella buona fede illimitata dei ricercatori che stanno elaborando gli embrioni della scoperta e perché non esiste un perimetro di controllo che sia in grado di arginare con concetti morali la sperimentazione e le realizzazioni che ne derivano. Così come sta accadendo oggi nella corsa allo spazio, dove le barriere tecnologiche si sono del tutto abbassate e ogni nazione un po’ industrializzata freme per raggiungere i suoi primati e battere i propri competitori. Già, questo è un altro dei punti che ci fa temere il peggio!

Ma torniamo a Terra perché ancora su questo pianeta dovremo vivere e convivere per diverse centinaia di anni. Forse anche un millennio prima di raggiungere nuovi mondi più ospitali e meno irti di ferocia e avidità umane. Dello «Strumento che ci permette di leggere la realtà e capirne le dinamiche» se ne trovano le prime tracce nella letteratura di Isaac Asimov. Il chimico e pure scrittore e divulgatore russo – naturalizzato statunitense – divenuto un riferimento fondamentale per la fantasia dell’intelligenza artificiale con le sue tre leggi della robotica divenute ormai un’icona nella narrativa della parte centrale del secolo scorso. Lo scienziato sosteneva che, se progettati bene, i robot dotati di cervello positronico devono rispondere a requisiti imprescindibili: sicurezza, obbedienza e autoconservazione. E non contento, Asimov ha formulato anche la Legge Zero: un robot non deve danneggiare l’umanità, né può permettere che, a causa del suo mancato intervento, l’umanità riceva danno. Quante di queste qualità sono già presenti nell’intelligenza artificiale del XXI secolo? Qualche tempo fa chiedemmo un’opinione a Mariarosaria Taddeo, professore associato e Senior Research Fellow presso l’Oxford Internet Institute dell’Università di Oxford e Dstl Ethics Fellow all’Alan Turing Institute di Londra. E lei ci rispose che: «Non abbiamo macchine pensanti, non abbiamo macchine a cui dobbiamo ricordare che l’umanità non deve essere danneggiata. Abbiamo esseri umani che progettano, sviluppano e usano macchine, a questi dobbiamo ricordare di fare il loro lavoro mettendo al centro l’umanità e l’ambiente. Ai legislatori e decisori politici dobbiamo ricordare la necessità di definire quadri regolatori che assicurino questi risultati senza ostacolare lo sviluppo tecnologico. Gli esperti di etica ci servono per definire gli equilibri giusti tra gli interessi legittimi, ma a volte contrastanti, degli stakeholders coinvolti. Non sono compiti facili, richiedono impegno e competenze, visto il passo dell’innovazione tecnologica, non ci possiamo permettere distrazioni». Tuttavia le preoccupazioni non possono mancare e se non si ripeterà l’errore di ricorrere a un neoluddismo che avversa ogni novità, come non porci qualche domanda su chi concretamente sostiene lo sviluppo dell’intelligenza artificiale?

Il giovane Ilya Sutskever, direttore scientifico di OpenAi, il laboratorio di ricerca applicata fondato da Elon Musk e Sam Altman nel 2015 a San Francisco, ha dichiarato che: «L’intelligenza artificiale è una tecnologia intrinsecamente pericolosa e da trattare con cautela» emarginandosi con il non lusinghiero appellativo di tecno-apocalittico (doomer). E del resto lo stesso Musk nel 2014 affermava: «Sviluppare l’intelligenza artificiale è l’equivalente tecnologico di evocare il demonio». E come non dar ragione a Melanie Mitchell, docente di Complessità all’Università di Santa Fe, quando ha affermato: «Vogliamo che le macchine facciano ciò che intendiamo, non necessariamente ciò che abbiamo detto». Ma alla fine, chi li controlla veramente questi scienziati o gli imprenditori che a parole si proclamano paladini del benessere mondiale salvo poi da agire come macchine di pressione verso i propri governi per aumentare l’utile delle proprie fabbriche? Oliviero Diliberto nella prefazione al libro di Giancarlo Elia Valori “Cyberspazio e intelligenza artificiale fra occidente e oriente” scrive: «L’intelligenza artificiale è un prodigio. Nel senso originario e autentico del termine, cioè ambivalente. Prodigium è, infatti, nella lingua latina, al contempo il prodigio come evento positivo e fausto, uno stupore meraviglioso, ma indicare anche l’essere mostruoso, innaturale, appunto non umano».

Siamo molto perplessi e lo ammettiamo. Perché nonostante le sfilate nei palcoscenici “giusti”, non si vedono dispositivi legali che regolano le responsabilità e limitano il potere che l’intelligenza creata in laboratorio possa avere in caso di uno sviluppo di decisione autonoma o di rischio per ambiente, cose e persone. Così, in conclusione ci piace ripetere la frase di un noto giurista romano: «A un’intelligenza artificiale preferisco alla fine il ragionamento di uno stupido naturale».