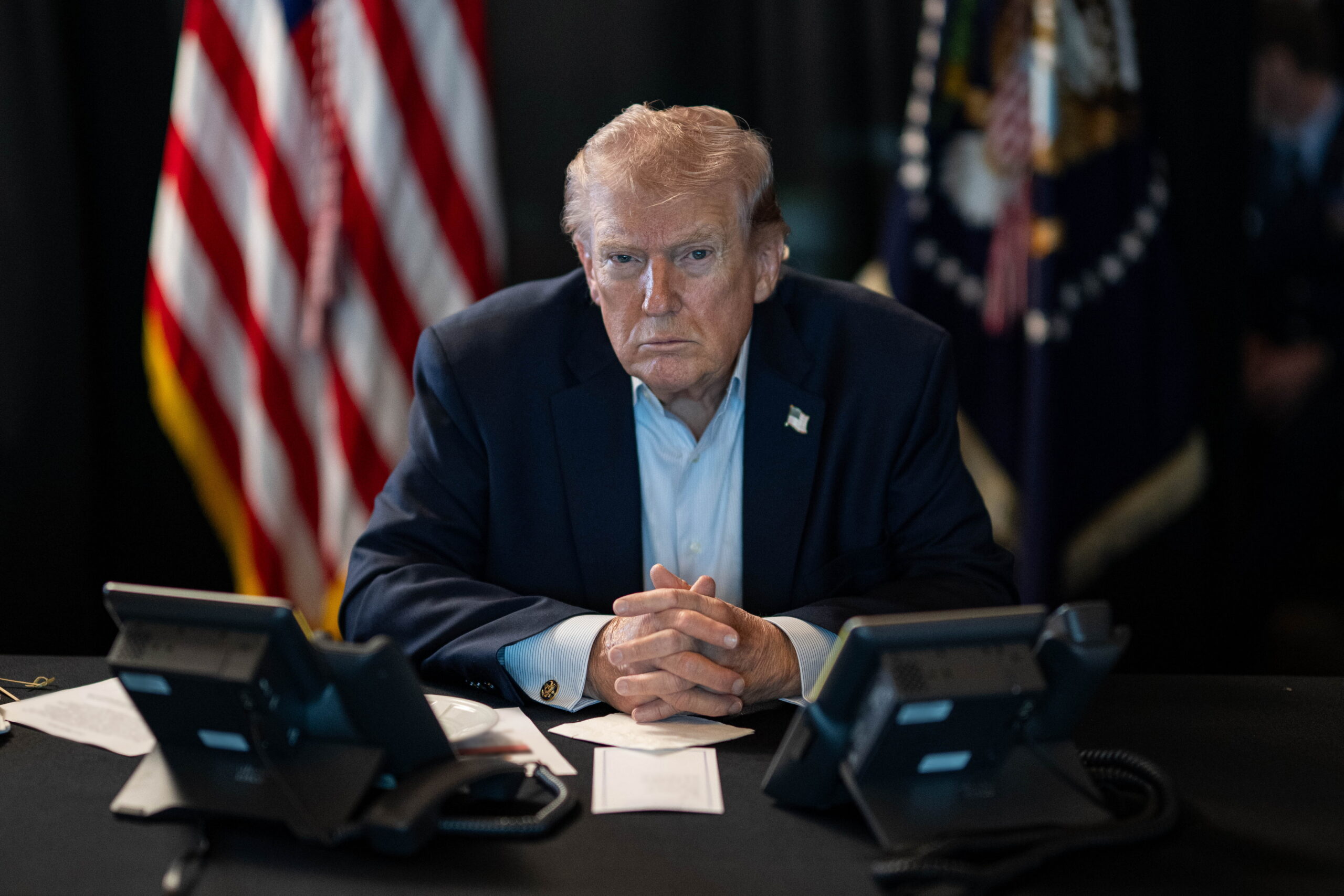

Era mezzogiorno del 6 gennaio 2021 quando a Washington Donald Trump è salito sul podio tra gli applausi di decine di migliaia di suoi sostenitori. Erano tutti venuti a difendere il “loro” Presidente, che aveva perso le elezioni ma che contestava – senza prove – i risultati. Nella folla, accanto agli attivisti di gruppi violenti come i Proud Boys, migliaia di americani che hanno risposto all’appello di uno slogan ampiamente diffuso sui social network: “Fermate il furto”.

Alle 12.20, davanti a una folla già molto arrabbiata, il Presidente in carica ha incitato i suoi sostenitori a marciare sul Campidoglio, dove i deputati e i senatori americani erano in procinto di certificare i voti. Questa è la routine del protocollo elettorale, ma Donald Trump crede di poterla rovesciare. “So che tutti i presenti presto si dirigeranno verso il Campidoglio, per manifestare pacificamente e patriotticamente e far sentire le loro voci”, ha annunciato.

Il messaggio è stato chiaramente ricevuto dagli elementi più violenti della folla; otto minuti dopo, la polizia del Campidoglio ha riferito che più di 10.000 persone stavano marciando lungo i viali principali della capitale federale verso l’edificio.

Allo stesso tempo, i computer dei centri di moderazione di Facebook e Instagram stavano impazzendo. Secondo migliaia di pagine di documenti interni al social network, recuperati dalla ex dipendente Frances Haugen e trasmessi da una fonte parlamentare americana a diversi media, tra cui Le Monde, il numero di segnalazioni di contenuti che incitano alla violenza hanno cominciato a esplodere sia su Instagram che su Facebook.

Il corso della giornata indicherà quali sono gli errori di previsione da parte della rete del social network, nonostante un piano d’azione preparato in anticipo. Ma anche la sua capacità di reagire molto rapidamente, con protocolli di emergenza messi in atto in poche ore, e i cui effetti sull’enorme meccanica algoritmica della rete digitale sono difficili da prevedere, anche per i migliori ingegneri della società.

“Su Instagram, abbiamo visto un picco di circa 4.000 segnalazioni all’ora per disinformazione, quattro volte di più rispetto al giorno prima”, nota un rapporto interno pubblicato il 7 gennaio, “e sette volte di più segnalazioni per violenza o incitamento alla violenza rispetto alla media. (…) Una gran parte dei messaggi più citati per incitamento alla violenza erano quelli di Donald Trump, o erano video di Donald Trump”, hanno detto gli analisti del social network. Su Facebook, le cifre sono di un ordine di grandezza completamente diverso: le segnalazioni di violenza sono aumentate di sette volte il 6 gennaio, ma in totale erano sei volte di più che su Instagram.

RISORSE LIMITATE E UN PIANO D’AZIONE BEN PRECISO

Di fronte a questo afflusso, i servizi di moderazione di entrambi i social network hanno subito il contraccolpo. Tanto più che i rapporti contengono “molti falsi positivi”, con “circa un terzo dei messaggi più segnalati che in realtà condannano la violenza”, nota un documento di revisione su Instagram.

Un altro documento, annotato durante quello che sembra essere stato un incontro di crisi tenutosi nel primo pomeriggio del 6 gennaio, quando la situazione a Washington ha iniziato ad aggravarsi, afferma il bisogno di assicurarsi che ci siano “abbastanza moderatori disponibili” e suggerisce che alcune misure di emergenza non possono essere messe in atto immediatamente a causa di una mancanza di risorse. Contattato da Le Monde, Facebook assicura che non ci sono state carenze nel suo personale di moderazione il 6 gennaio.

Tuttavia, la preoccupazione per questo problema non è recente: nel luglio 2020, una nota interna, scritta dai responsabili del sistema speciale istituito da Facebook per garantire la sicurezza delle elezioni, avvertiva del rischio di una mancanza di risorse umane. “Abbiamo solo 2,5 FTE [posizioni equivalenti a tempo pieno] per coprire tutto il nostro flusso permanente di sorveglianza elettorale durante le ore d’ufficio”, lamentavano gli autori all’epoca.

Facebook aveva comunque preparato un piano d’azione dettagliato prima del 6 gennaio, con più livelli di azioni da intraprendere e misure di firewall elencate in diverse tabelle complete. La prima parte, spiegata in un documento intitolato “Risposte immediate al rischio di violenza a Washington”, elenca una serie di misure che sono state messe in atto nel tratto finale della campagna elettorale e poi disattivate dopo le elezioni. La maggior parte di esse sembra essere stata riattivata nelle prime ore del pomeriggio del 6 gennaio, tra cui la sospensione dei commenti nei gruppi identificati come “a rischio” e una riduzione della diffusione di contenuti giudicati come probabilmente pericolosi dagli strumenti di intelligenza artificiale di Facebook.

Molti critici dell’azienda l’hanno accusata di aver disattivato queste misure di sicurezza troppo presto. Facebook sostiene che le sue decisioni in questo campo si sono basate su “segnali specifici rilevati sulle nostre piattaforme, o dati a noi dalle forze dell’ordine”. Le misure che erano necessarie sono rimaste in vigore a febbraio, e alcune, come il blocco delle raccomandazioni per i gruppi politici appena creati, sono ancora in vigore oggi”, ha detto un portavoce dell’azienda.

Già nel giugno 2020, il social network aveva identificato tre “scenari ad alto rischio” per le elezioni: disinformazione sul voto, risultati contestati e “incitamento ambiguo” alla violenza. Questi tre scenari sono stati combinati nel discorso di Donald Trump del 6 gennaio. Ma quando è iniziato l’attacco al Campidoglio, le misure di Facebook, come il dispiegamento della polizia, sono sembrate improvvisamente insufficienti. Alle 13.30, la polizia è stata sopraffatta, i manifestanti hanno marciato sugli edifici; venti minuti dopo, il comandante della polizia ha chiesto, invano, l’appoggio della Guardia Nazionale. I rivoltosi hanno rotto le finestre e sono entrati negli edifici del Congresso poco dopo le 14.00; è iniziata l’evacuazione d’emergenza dei deputati.

Allo stesso tempo, su Facebook, un articolo del Washington Times circolava ad alta velocità: sosteneva che una società specializzata in videosorveglianza avanzata aveva identificato diversi “antifas”, militanti antifascisti, nella folla. Condiviso più di 350.000 volte sul social network, l’articolo rafforza una voce che sta già circolando nelle chat repubblicane: gli aggressori di Capitol Hill non sono sostenitori di Trump ma anarchici e attivisti di estrema sinistra che hanno condotto una “operazione false flag” per screditare il Presidente in carica.

L’articolo è stato leggermente modificato, troppo tardi, il giorno dopo; nel frattempo, le misure messe in atto da Facebook non gli hanno impedito di acquisire un pubblico enorme. In un’analisi a posteriori condotta a metà febbraio, un ingegnere del social network ha spiegato che Facebook, lo stesso giorno, aveva progettato uno strumento per rilevare i contenuti che sostengono falsamente che l’attacco al Campidoglio sia opera di attivisti anti-Trump.

“La precisione ha raggiunto il 95% (…) e, con l’accordo della squadra antidisinformazione, siamo stati in grado di iniziare automaticamente a limitare la distribuzione di questi messaggi”, ha detto. Ma a causa di un’incompatibilità tecnica, Facebook non è stato in grado di applicare questo filtro ai contenuti che erano già stati pubblicati, come è la normale procedura interna. Un tentativo di risolvere il problema con urgenza è fallito.

VIDEO IN DIRETTA

Poco prima delle 3 del pomeriggio, un gruppo di manifestanti, alcuni dei quali indossavano i simboli del movimento cospirativo QAnon, hanno cercato di forzare una porta che arriva agli uffici del Senato. Un poliziotto ha aperto il fuoco per respingere quelli tra loro che avevano appena rotto una finestra; Ashli Babbitt, una donna che seguiva vari account QAnon su Instagram, è stata colpita ed è morta poche ore dopo. La scena è stata trasmessa in diretta su Facebook da altri manifestanti che l’hanno filmata.

I video dal vivo sono storicamente alcuni dei contenuti più difficili da moderare – è una delle aree principali in cui gli strumenti automatici funzionano molto male, costringendo Facebook e Instagram a fare più affidamento sull’analisi umana. Un documento intitolato “Anticipazione dei rischi”, evidentemente preparato in vista del 6 gennaio, prevedeva anche di dividere per dieci la forza di certi segnali che normalmente danno molta visibilità ai video in diretta. Facebook non dice se, o quando, la misura è stata applicata, ma specifica che questo tipo di misura di emergenza può avere effetti collaterali pericolosi, e afferma che usa questo tipo di strumento solo con grande cautela.

Mentre la situazione a Washington si aggravava e gli attivisti si fotografavano vittoriosi nell’ufficio della presidente della Camera Nancy Pelosi, gli ingegneri di Facebook e Instagram hanno continuato ad attuare nuove misure, alcune delle quali sembravano essere state preparate in anticipo, e altre decise il giorno stesso, come il cambiamento degli strumenti di moderazione per evitare che cancellassero per errore i post che denunciavano la violenza. Un documento non timbrato elenca le protezioni già in atto per Instagram, e quelle a venire; alla domanda “perché i nostri soliti strumenti non sono sufficienti”, risponde:

“Non abbiamo protezioni per l’incitamento alla violenza su feed, lista degli hashtag più popolari e stories”.

Vengono proposte misure di emergenza che possono essere dispiegate in “una o due ore”, ma non sono mai state testate e possono avere conseguenze indesiderate. “Rischio di danni collaterali: alto”, commenta l’autore del documento di fronte alla proposta di declassare tutti i video in diretta alla lista delle “storie”. “Questo riguarda tutti i flussi in diretta, ci sarà un significativo tasso di falsi positivi”.

DONALD TRUMP DISCONNESSO

Nel frattempo, Donald Trump ha continuato a postare su Facebook. Poco dopo le 15, ha scritto un nuovo messaggio che invitava i manifestanti a mantenere la calma e a non attaccare la polizia, che ha immediatamente scatenato decine di migliaia di commenti. Su Twitter, il tono del Presidente uscente è molto più marziale. In un video postato poco dopo le 16, ha continuato a sostenere che le elezioni gli sono state “rubate”.

A Capitol Hill, la situazione era ancora fuori controllo, ma il dispiegamento della Guardia Nazionale fu finalmente autorizzato; i primi soldati arrivarono un’ora dopo e fecero rapidamente piazza pulita dei rivoltosi. Nel frattempo, un’altra donna, Rosanne Boyland, era stata calpestata dai manifestanti ed è morta in serata per le ferite riportate.

Alle 18, il coprifuoco decretato dal sindaco di Washington è entrato in vigore. La calma è tornata nella capitale americana, ma non sui social. Donald Trump ha pubblicato un nuovo tweet per giustificare la violenza, descritta come “ciò che accade quando una vittoria elettorale così grande e sacra viene ferocemente rubata ai grandi patrioti che per tanto tempo sono stati ingiustamente trattati male “. Un’ora dopo, Facebook e poi Twitter hanno cancellato i post del Presidente uscente.

“Abbiamo rimosso il recente video del presidente Trump sulla protesta, e il suo successivo post sui risultati delle elezioni, da Facebook e Instagram”, ha scritto Facebook. Abbiamo preso questa decisione perché riteniamo che questi post aumentino, piuttosto che limitare, il rischio di ulteriori violenze”. Un’ora e mezza dopo, il social network ha bloccato gli account del Presidente in carica per ventiquattro ore. I documenti consultati da Le Monde e dai suoi partner non fanno luce su come questa decisione sia stata presa, ma secondo la stampa americana, la scelta sarebbe stata convalidata dallo stesso Mark Zuckerberg.

Troppo poco, troppo tardi? Sul sistema di messaggistica interna di Facebook, la misura è stata accolta con una certa freddezza da alcuni dipendenti, come mostrano gli screenshot delle risposte al messaggio interno di Mark Zuckerberg.

Il rispettato chief technology officer di Facebook, Mike Schroepfer, è stato educatamente ripreso dai dipendenti dopo aver pubblicato un messaggio di condoglianze misto a un invito a migliorare il sistema.

“Con il senno di poi, ovviamente è molto più facile vedere cosa è andato storto”, ha detto poco dopo un analista di Facebook in un documento riassuntivo sul movimento “Stop the Steal”, i cui gruppi sono stati tutti banditi da Facebook l’11 gennaio:

“All’epoca, era difficile capire se stavamo assistendo a un movimento concertato per delegittimare le elezioni o se si trattava di utenti confusi e smarriti che semplicemente affermavano il loro diritto alla libertà di parola”.

Lo stesso documento mostra, con cifre, che i gruppi “Stop the steal” stavano comunque accumulando un numero eccessivamente alto di messaggi d’odio ed espressioni razziste fin dall’inizio. Sono tutti elementi che avrebbero dovuto allertare Facebook e che non erano sfuggiti all’attenzione di tutta la stampa americana fin dall’inizio del movimento.

(Estratto dalla rassegna stampa estera a cura di Epr Comunicazione)